meta7月19日在其kf凯发官网宣布大语言模型llama2正式发布,这是meta大语言模型的最新版本,也是meta首个开源商用的大语言模型,同时,微软azure也宣布了将与llama2深度合作。

根据meta的官方数据,llama 2 相较于上一代其训练数据提升了40%,包含了70亿、130亿和700亿参数 3个版本。llama 2 预训练模型接受了 2 万亿个 tokens 的训练,上下文长度是 llama 1 的两倍,其微调模型已经接受了超过 100 万个人类注释的训练。

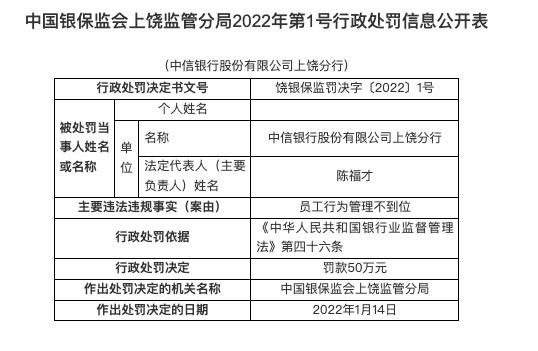

【资料图】

其性能据说比肩gpt-3.5,也被称为开源最优的大模型。消息一经发布,媒体与业界甚至给出了llama2开源商用,即将改变大模型领域竞争格局的论断。这件事的影响究竟有多大?即将给产业带来什么样的影响?我们邀请两位业界人士聊了聊,一位是利欧集团数字科技有限公司产品研发中心副总经理周崧弢,他带领团队几乎评测了国内外主流的大部分大模型;另外一位是安信元宇宙研究院院长焦娟,多年一直深度观察国内外的科技产业生态。

meta商用开源最牛大模型背后:巨头保命式竞争,马斯克、苹果另辟蹊径-kf凯发

① llama2在模型参数、时间消耗、算力消耗等方面综合考虑,与gpt-3.5对比是有底气的。

② 生成式人工智能会给整个开源体系带来天翻地覆的变化。

③ 未来一段时间内,开源和闭源一定是互相摇摆,在这个领域会形成相当长一段时间的互相的博弈和竞争的格局。

④ llama2的商用开源不一定会降低创业者使用大模型的成本,但是有可能引起大模型服务商开始打价格战,这对于应用者和创业者来说是个好消息。

⑤ 海外巨头在ai领域的竞争,已经不太像是发展第二曲线这么简单,竞争激烈而决绝,甚至有点保命的味道,背后的原因值得深思。

腾讯科技:从行业从业者或应用者角度,如何去评测一个大模型?

周崧弢:国际上用的比较多的大模型评测框架是mmlu,它考虑了57个学科,从人文到社科到理工多个大类的综合知识能力,我们大多数情况也是基于这个框架来评测。但是我们的行业是广告业,基于广告业的属性,会增加一些其它的评测项目。

我们在集团的管理会上也说过,广告业的重点不在于创造力,而在于控制。生成的结果一定要和广告主、它的产品性能、外观、logo等,有100%的还原。在这些还原达成之后,才能有发散和想象的空间。所以我们会针对于大模型的幻觉的控制,去做单独的测试。但是绝大多数市面上的大语言模型及图片生成的扩散模型,都很难百分百满足广告主的需求。通用大模型被发布之后,离完全商用还有很长一段路要走。

另外,我们考虑的最重要的就是成本问题:闭源模型有直接的报价体系,我们一般会衡量千token的费用。对于开源模型来说,要测算的环节更多,从部署到精调到最后上线进行推理,算力消耗成有多少,维护开源模型投入的开发成本、数据成本有多少。

大模型质量反馈加上成本的估算,我们就能形成一个对模型的评价,简单一句话就是,性价比越高,越受欢迎。

焦娟:从我们的角度来讲,更看重的是如何去定义一些垂直方向的需求。因为全球范围来讲的话,不管是硬科技公司还是互联网公司,真正有能力去定义需求的可能不会特别多,所以这个命题就可以转换成——大模型公司自己能不能去定一些垂类的细分方向的需求,如果不能的话,能否联合生态kf凯发的合作伙伴探索出比较好的垂类方向。当然,如果某些公司自己能够在特定的方向中有自身的数据积累、经验积累那会更好。这是我们的视角,从应用、定义垂类细分行业需求的角度。

腾讯科技:llama2在性能上真的可以超越或比肩gpt-3.5吗?

周崧弢: 针对llama2的大模型还在评测中,大约需要2周的时间。但是从我们对于论文的学习,和目前已经进行的一些简单的评测中,可以讲一些大概的比较。

在预训练的阶段和gpt原来的模式有几点不同,而且这些改变,之前其它模型公司都没有做过。首先就是在预训练阶段,将传统transformer的多头注意力机制,改变为分片群组的机制。有点类似或模仿我们原来在做大数据处理的时候,处理大规模并行数据的时候,所用的分片的技术。把大量的attention需要的query(请求)一组一组成组起来,每个组放到一个训练单元里面去,这样并行的效率和速度,理论上是会大幅提升。这部分我觉得是meta在之前大规模并行处理经验上,做出的一个新的改变。

基于这个改变,我觉得他们理论上在算力的需求和时间消耗上,比现有的大模型要提升很多倍。我预估llama2按照他们的说法,是一月份就开始做,按照发布时间来计算,比llama1的预训练时间应该要短,因为它的参数量比llama1要大。这样的话,多轮训练的可能的这个周期是被压缩的。这和论文中所提到的gqa密切相关。在这一点上,应该是超过了gpt4的,虽然我们不知道gpt-4具体是多少,但是根据外界猜测,gpt-4是远高于gpt-3和gpt-3.5的。

对gqa,我们目前觉得,gqa的处理方式对于有足够算力卡,特别是有gpu并行算力资源的用户来说,的确可以提高训练速度。不过测试和同行测评发现这个功能对算力池规模和硬件要求很高,因为众所周知的原因,中国内地的开发者拥有大规模gpu并行算力资源的少,所以gqa可能会对我们来说是鸡肋。

另外第二点,在调整阶段,我们知道gpt体系在归一化的时候,都做了层化的数据处理,使得数据训练的结果很精确,但是也非常消耗算力。但是llama2用了不一样的方案,就是在分层处理的基础上又加了权重系数,这样对于效率的提升和准确度维持是很有帮助的,对算力的节约也是有帮助的。这两点是在预训练阶段所做的优化。

另外论文中也提到,llama1的embedding位置是固定的,不能修改。但是在llama2中,这是可以动态调整的,这也是一个亮点。这个我们也很感兴趣,想知道究竟能产生什么样的实际效果。

除了这些,llama2很明显吸收了llama1及gpt系列的一些工程化经验,就是在rhlf阶段的成功经验都复用了,应该会有很大的改善。

最后就是比参数,目前看到的就是它自己在kf凯发官网上公开的那些参数。包括它的人工强化反馈的参数大概有100多万,精调的部分达到十几万。这些参数的话,他敢放出来就意味着,meta在模型参数、时间消耗、算力消耗等方面综合考虑,是有底气的。

腾讯科技:为什么商用开源的门槛设定到了月活跃用户数不超过七个亿?

焦娟:开个玩笑,我觉得这个规定还是“很敞亮的”——meta打出了一张明牌,既然防不住别人去研究,那就干脆放开。本质上是内部博弈的一种结果。meta的财务指标从2021年初就不是太好了,所以一直也在寻找第二增长曲线。2021年10月meta改名,all in 元宇宙,但是并没有看到太实质的起色。它推出现在的大模型,是可以与自身的硬件融为一体的。相当于打出来一张明牌,既要硬件、又要软件、又要操作系统,希望能在ai时代有自己的一席之地,但是开源的同时,也不希望能够太有利于竞争对手。大家可以看到,7亿月活的产品有youtube 25亿、苹果 18亿、微软 14亿、三星 10亿、领英 9亿、snapchat 7.5亿等。

腾讯科技:商用开源和研究授权究竟有什么本质不同?对开源生态可能会有什么不同的影响?

周崧弢: 大语言模型爆发之后,开源这件事情也变得很复杂,大家对于开源的定义和这个规则做了很多的调整。会涉及到你是算法本身开源、数据研究开源等等。对于现在新的语言模型或者是生成式模型的整体的开源的判断:第一是要看它的算法代码是不是开源,然后看它的训练数字集会不会开源出来。第三看基于开源算法,如果我做了精调或者是其它处理,你的授权政策会有什么样的约束。第四就是使用你的模型推理出来的结果,模型方是不是有控制权。我们一般从这几个方向来判断,这个模型的“开源”对我们是否真的有应用价值。

关于研究开源和商业开源,我记得最典型的例子就是stability ai这家公司,我记得llama2开源前的两周,stabilityai的xl那个版本也发布了,就是只有研究授权开源,明确规定,可以用模型和数据去做研究,比如你是研究员或者是属于某所高校,但是如果用这个模型去做商业化,是完全禁止的,需要单独申请授权才有可能使用。

大模型的开源授权,我觉得和原来开源的那套逻辑已经有很大变化,环节和流程设置得非常细,有可能生成式人工智能会给整个开源体系带来天翻地覆的变化。

腾讯科技:llama2的商用开源,会对大模型的竞争格局造成什么样的影响呢?

焦娟:海外巨头的竞争中,有一个风格,就是要让自己的产品和服务有辨识度,所以meta叫元宇宙,苹果一定要叫新宇宙,别人闭源,我就要占领开源。过去的开源,可能是有自由情怀的极客去做的事情,思路也比较简单。而现在如此大的商业体去主导这件事,更多还是商业利益上的考虑。

周崧弢:我认为整个生成式人工智能这个体系竞争格局的三要素——算力、算法、模型,还是没变。其实模型只占三分之一的竞争因素,模型改变的话,最多只能改变三分之一或者比三分之一多一点,我估计乐观一点,可能到45%左右。

国内和国外的格局还是不太一样,国外算法层面的格局比较明显。国外的数据基本是被清洗过和被矢量化过的,训练数据集已经很充分了,在数据方面的竞争优势不明显,除非你具有某个行业的专有数据。算力也不是国外巨头能拉开差距的地方,巨头其实都有实力去拼算力。

首先,国内拥有核心底层算法的公司其实很有限;第二,国内的数据,被清洗程度、矢量化程度其实是不高的。早期如果投入大量的力量做数据的结构化处理的公司,其实它可以弥补在算力、在算法上面的不足。第三,国内其实是短期之内是缺算力的。所以llama2开源对于国内的格局的影响,目前来讲并不好判断。

再说回国外,整个生成式人工智能里面,谷歌才是真正的先驱,然后他差点就被搞成先烈了。就是因为整个生成式人工智能的源出论文就是《attention is all you need》,然后包括最早的开源模型t5其实都是谷歌的。曾经谷歌也是笑傲群雄。不料后来杀进了一匹黑马openai,最早gpt-1、gpt-2都是开源的,gpt-3开源之后又闭源了。当openai进场的时候,开源才是整个生成式人工智能的主流。

openai这个时候找到了微软,也拥有了很贵的算力,成了谷歌强有力的竞争对手。2022年开始,生成式人工智能这个市场,就开始进入到闭源的体系中。openai从掌握算法,加上微软的算力、数据,闭源打造产品,产品又成了现象级的爆款,微软和openai都从中获益。我认为meta开始决定进入到这个领域的时候,估计也是从头开始仔细研究了发展历史,既然看到了openai从开源领域撤回到闭源,那我还是用开源的方式,再重新打败你的魔法。

在这之前,meta也看到了几家小公司开源之后的生命力,特别是stability ai,这家公司并没有深厚的根基,要钱没钱、要技术没技术,突然之间杀出来的,虽然这家公司现在还是有很多的争议。

我记得llama1是3月份就是对外宣布开源,当时还说是“不小心开源的”,然后stability ai也说我是不小心把代码泄露了,所以也开源了。整体路径是,谷歌奠定了开源的基调,然后openai和微软又把它折回到闭源的体系里面,然后meta和stability ai又把它又放到了开源里面,我觉得未来一段时间内,开源和闭源一定是互相摇摆,在这个领域会形成相当长一段时间的互相的博弈和竞争的格局。

腾讯科技:meta开源llama2是迫不得已还是主动战略选择?

焦娟:肯定是主动战略选择,因为本身meta、微软、谷歌三家在ar领域主要的三个竞争对手,混战了大概有十几年。meta很快地推出了llama2,至少比谷歌要快。开源和闭源的选择,都不会脱离掉本质的一些利益诉求,所以说彻底改变竞争格局,我觉得可能意义没那么大。第二就是国内的情况不太一样,所以国内的竞争格局要再观察一下。

不管是开源还是闭源,本质上就是全球这几家公司彼此之间在新的大机遇面前的战略选择。在发力布局眼前的时候,还希望尽可能去攻占比尔呢的腹地。海外巨头的竞争,都已经不太像是发展第二或第n增长曲线这么简单。竞争激烈而决绝,甚至有点保命的味道。

我觉得这点才是最值得大家去探讨的:他们这些行为的背后到底是什么样的大环境或者大背景,让他们一定以这样决绝的方式、军备竞赛一样的方式去做这件事情。

最近也有一些值得关注的事情发生,马斯克的x-ai这家公司的成立,它要重新理解现实物理世界,所有巨头都在盯着agi的真正实现。这个版图越来越大。然而,新的商业世界和新的商业版图,总需要有一些新的爆款应用和爆款产品来做牵引,这在2023年实现可能还有点难。我们可以把希望放到2024年,也许苹果的mr眼镜会是一个新的契机。

腾讯科技:我们还看到另外两家海外巨头,马斯克和苹果,并没有高调宣布自己在大模型领域的进展,这点怎么看?

焦娟:他们只是暂时按兵不动,而且可以肯定的是,他们推出的东西,肯定不会再叫大模型。我觉得我们可以再去关注下一层,具身智能。在这个方向,马斯克是最不用担心的。而苹果最大的优势在于软硬结合。

周崧弢:我们自己也大概测了一下,m2的芯片在浮点算力上面是可以和英伟达的卡去抗衡。苹果有可能走的是软硬件一体化,它其实是超越大模型目前的竞争格局。

具身智能,我觉得有可能是未来整个通用人工智能发展的一个新的里程碑,因为一旦你拥有了强大的推理能力,一定会扩展到物理世界,而控制物理世界的核心点,就是要嵌入身体或者是嵌入到物理世界的传感器中,那这就是变成具身智能的体系。就如刚刚周老师所说,这个是反而又变成了马斯克的一系列公司。

当我们把软件和硬件重新结合在一起去看整个通用人工智能的时候,你就会发现,竞争格局又发生改变了,已经不是google、meta和open ai这几家在竞争,而是有可能会有更多的硬件公司加入进来。

腾讯科技:llama2的商用开源,是不是有可能把大模型创业的成本打下来?

周崧弢: 这块我现在不确定,因为虽然是省了租用api的开销,但是你会发现6月15号openai大降价之后几乎是一折促销,所以闭源模型也在打价格战。反而是说,如果用开源模型的话,需要多少硬件成本、算力成本、数据成本?隐含成本不好估算。单纯从llama2的开源来说,我觉得对于创业来说的话,不见得是一个节约成本的路径。

针对推理成本,我们目前测的和结合国外测试者的评价文章,发现一些特定类型的推理任务,比如分类或者langchain的工作流,llama2的推理效率和时间消耗是减少了,但是其他类型的任务,如果和gpt-3.5-turbo-0615的快照版本相比,不一定会便宜(仅仅是推理算力消耗方面);还有就是现在的原厂版本对中文理解非常流畅和准确,但是中文表达几乎是0,所以中国的创业者想要完全用上llama2必须花大的代价解决中文表达的精调或者引导,或者等开源社区提供中文的表达版提供……这个成本不低。

另外,llama2的商用开源,确实有可能引起大模型服务商开始打价格战,这对于应用者和创业者来说是个好消息。

焦娟:坦率讲,在国内我还是比较期待一些行业模型或垂类模型。我自己挑了大概几家看好的公司,特征是一直在这个行业内做的很扎实,有持续的数据积累和平台建设的经验。另外就是,我觉得这轮并不是一个船票贵不贵的一个问题,而是你不管贵不贵,大家都面临着转型。

编辑/lambor

美联储激进加息对a股和港股

美联储激进加息对a股和港股  喜力在华业务被华润收购五年

喜力在华业务被华润收购五年  深圳坪山新能源车产业园一期

深圳坪山新能源车产业园一期